近日,智源研究院联合上海交通大学等机构正式发布了一款新一代超长视频理解模型——Video-XL-2。这一模型的推出标志着长视频理解技术在开源领域取得了重大突破,为多模态大模型在长视频内容理解方面的发展注入了新的活力。

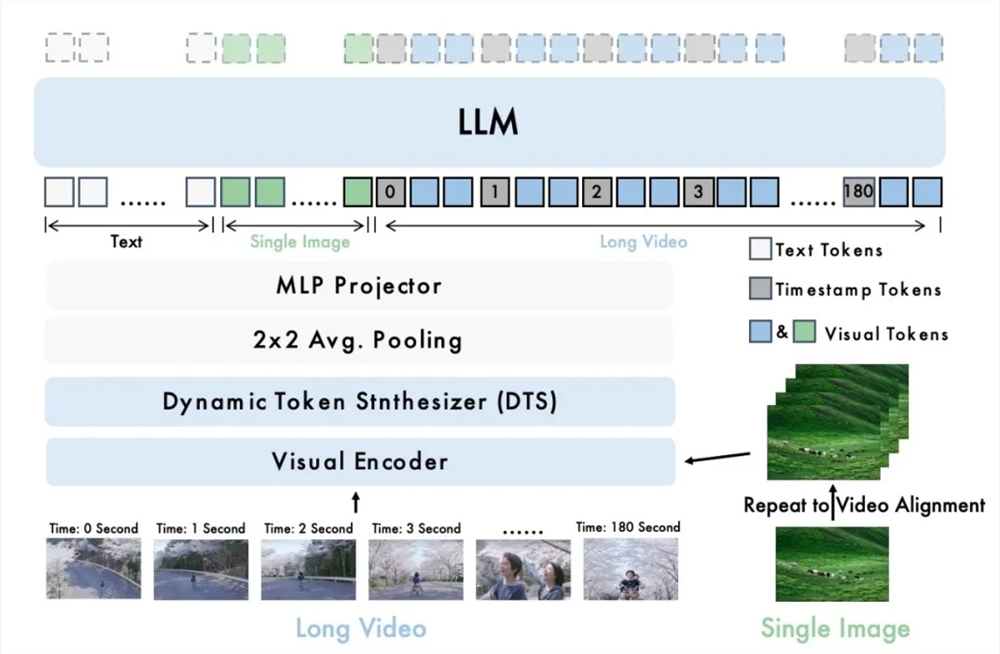

在技术架构方面,Video-XL-2主要由视觉编码器、动态Token合成模块(DTS)以及大语言模型(LLM)三个核心组件构成。该模型采用SigLIP-SO400M作为视觉编码器,对输入视频进行逐帧处理,将每一帧编码为高维视觉特征。随后,DTS模块对这些视觉特征进行融合压缩,并建模其时序关系,以提取更具语义的动态信息。处理后的视觉表征通过平均池化与多层感知机(MLP)进一步映射到文本嵌入空间,实现模态对齐。最终,对齐后的视觉信息输入至Qwen2.5-Instruct,以实现对视觉内容的理解与推理,并完成相应的下游任务。

在训练策略上,Video-XL-2采用了四阶段渐进式训练的设计,逐步构建其强大的长视频理解能力。前两个阶段主要利用图像/视频-文本对,完成DTS模块的初始化与跨模态对齐;第三阶段则引入更大规模、更高质量的图像与视频描述数据,初步奠定模型对视觉内容的理解能力;第四阶段,在大规模、高质量且多样化的图像与视频指令数据上进行微调,使Video-XL-2的视觉理解能力得到进一步提升与强化,从而能够更准确地理解和响应复杂的视觉指令。

此外,Video-XL-2还系统性设计了效率优化策略。它引入了分段式的预装填策略(Chunk-based Prefilling),将超长视频划分为若干连续的片段(chunk),在每个chunk内部使用稠密注意力机制进行编码,而不同chunk之间则通过时间戳传递上下文信息,显著降低了预装填阶段的计算成本与显存开销。同时,Video-XL-2还设计了基于双粒度KV的解码机制(Bi-granularity KV Decoding),在推理过程中,模型会根据任务需求,选择性地对关键片段加载完整的KVs(dense KVs),而对其他次要片段仅加载降采样后的稀疏的KVs(sparse KVs),有效缩短了推理窗口长度,从而大幅提升解码效率。得益于这些策略的协同优化,Video-XL-2实现了在单张显卡上对万帧级视频的高效推理,显著增强了其在实际应用场景中的实用性。

在实验效果方面,Video-XL-2在MLVU、VideoMME和LVBench等主流长视频评测基准上全面超越现有所有轻量级开源模型,达成当前最先进性能(SOTA),相较第一代Video-XL实现了显著提升。尤其值得关注的是,在MLVU和LVBench上,Video-XL-2的性能已接近甚至超越了如Qwen2.5-VL-72B和LLaVA-Video-72B等参数规模高达720亿的大模型。此外,在时序定位(Temporal Grounding)任务中,Video-XL-2也在Charades-STA数据集上取得了领先的结果,进一步验证了其在多模态视频理解场景中的广泛适用性与实际价值。

在视频长度方面,Video-XL-2展现出显著优势。在单张24GB消费级显卡(如RTX3090/4090)上,Video-XL-2可处理长达千帧的视频;而在单张80GB高性能显卡(如A100/H100)上,模型更支持万帧级视频输入,远超现有主流开源模型。相较于VideoChat-Flash和初代Video-XL,Video-XL-2显著拓展了视频理解的长度并有效降低了资源需求,为处理复杂的视频任务提供了有力的支撑。

在速度上,Video-XL-2也展现出卓越性能。仅需12秒即可完成2048帧视频的预填充,其预填充时间与输入帧数之间呈现出近似线性增长,体现了其出色的可扩展性。相比之下,Video-XL与VideoChat-Flash在输入长视频条件下的工作效率明显落后于Video-XL-2。

得益于出色的视频理解能力与对超长视频的高效处理性能,Video-XL-2在多种实际应用场景中展现出很高的应用潜力。例如,在影视内容分析方面,它可以快速准确地理解电影情节,回答相关问题;在监控视频中,它能够检测异常行为并发出安全预警;此外,它还可以用于影视作品的内容总结以及游戏直播内容的分析等任务,为现实世界中的复杂视频理解需求提供高效、精准的技术支撑。

目前,Video-XL-2的模型权重已全面向社区开放,项目主页、模型链接和仓库链接均已公布,未来该模型有望在更多实际场景中发挥重要作用,推动长视频理解技术的进一步发展。

项目主页:

https://unabletousegit.github.io/video-xl2.github.io/

模型hf链接:

https://huggingface.co/BAAI/Video-XL-2

仓库链接:

评论 (0)