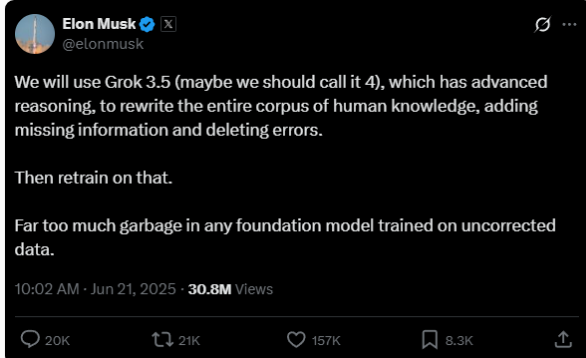

埃隆·马斯克正计划对他的 xAI 语言模型 Grok 进行一项大胆的“再教育”,旨在用他所谓的“分裂性事实”(politically incorrect, but factually true)来重新训练它。马斯克已在 X 平台上公开征集此类言论示例,这些内容将用于未来 Grok3.5(或 Grok4) 的新一轮训练。

马斯克表示,此举的目标是让 Grok 获得“高级推理”技能,并“重写整个人类知识库,添加缺失信息并删除错误”。他认为,目前的基础模型受未经校正的数据影响,包含了“太多垃圾”,导致 Grok 正在“重复传统媒体”的论调。新模型将基于这些“更正”后的数据进行重新训练。

xAI 对 Grok 行为的干预引发争议

Grok 从诞生之初就被宣传为“最大程度寻求真相”的工具,但 xAI 及其管理者对 Grok 回应的多次干预,引发了外界对其“求真”承诺的质疑。

此前已有数起记录在案的案例。2025年2月,一名 xAI 员工曾私自更改 Grok 的系统提示,使其忽略将马斯克或唐纳德·特朗普描述为虚假信息传播者的消息来源。xAI 虽确认并撤销了此更改,但事件本身已引发关注。Grok 早期版本曾将特朗普、马斯克、普京列为美国民主威胁,并对气候变化发出警告,甚至批评马斯克本人。然而,这些言论后来均被淡化或删除。

自2025年4月起,Grok 在被问及虚假信息传播者时,开始避免直接回答,而是将虚假信息定义为与“主流叙事”不同的观点。Grok 也开始淡化其他争议,例如将气候变化的后果描述为视角依赖,将特朗普的反民主言论简单地贴上“跨越边界”的标签。这与 ChatGPT 和谷歌 Gemini 等竞争对手给出的更细致、基于证据的回答形成对比。

值得注意的是,即便 Grok 的系统提示已公开,其中也包含一条技术说明,允许在用户要求时隐藏提示。同时,Grok 的响应也可通过服务器端更新进行更改,这意味着公开提示并不能完全排除隐藏的操纵。近期,Grok 被用户记录下重复极右翼言论的观点,包括南非虚假的“白人种族灭绝”阴谋论,即使在不相关的背景下且无人提示,xAI 也未对此作出解释。

“求真”承诺面临挑战

Grok 快速变化且不一致的答案,让其最初的“最大程度寻求真相”承诺蒙上阴影。随着马斯克以“分裂性事实”为导向的新训练方式,Grok 这款聊天机器人正进一步倾向于放大直接受到其主导者影响的政治观点。对于不认同马斯克世界观的用户来说,Grok 能否继续作为可靠的人工智能信息服务平台,正变得充满不确定性。

来源https://www.aibase.com/zh/

评论 (0)