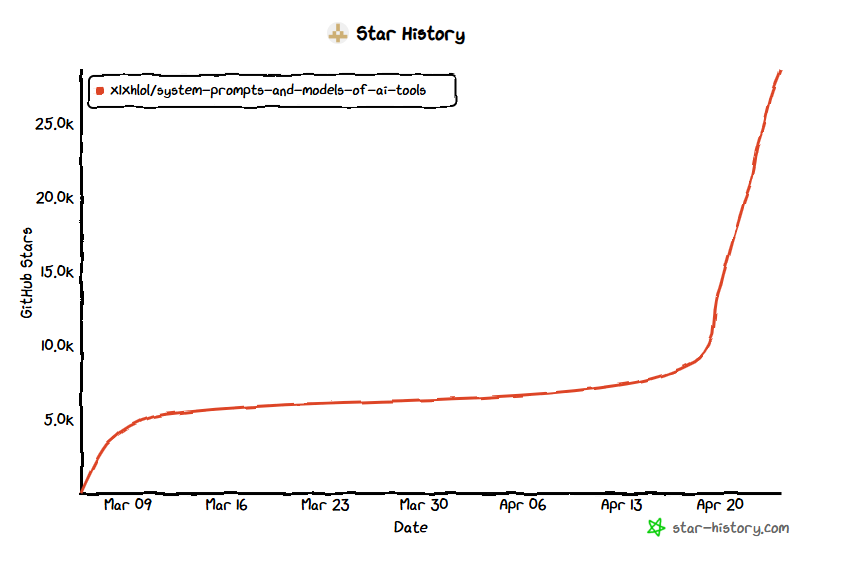

GitHub上一款名为“system-prompts-and-models-of-ai-tools”的开源项目引发广泛关注,累计获得30.5K星,成为AI开发者与研究者的热门资源。据AIbase了解,该项目汇集了9款主流AI工具的系统提示词与模型配置,包含6500+行内容,覆盖v0、Cursor、Manus、Same.dev、Lovable、Devin、Replit Agent、Windsurf Agent和VSCode Agent,提供了深入理解AI工具设计思路的宝贵参考。相关细节已通过GitHub与社交平台公开。

核心亮点:6500+行提示词,解构9大AI工具

“system-prompts-and-models-of-ai-tools”项目通过系统化整理,为开发者提供了全面的AI工具提示词库。AIbase梳理了其核心内容:

9大工具覆盖:包括v0(Vercel生成式UI)、Cursor(AI代码编辑器)、Manus(智能代理)、Same.dev、Lovable(协作开发)、Devin(AI软件工程师)、Replit Agent、Windsurf Agent和VSCode Agent,涵盖开源与闭源工具。

6500+行提示词:提供超过6500行的系统提示词与内部工具配置,揭示各工具的角色定义、行为约束与功能设计,如Cursor强调代码修改的安全性,Manus拥有200+行复杂指令。

设计思路洞察:通过提示词分析,开发者可了解AI工具如何通过指令优化代码生成、减少幻觉并提升用户体验,例如Cursor通过规范约束AI输出,降低错误率。

学习与研究价值:适合AI从业者、提示工程研究者与初创公司,学习如何设计高效的系统提示词,或借鉴最佳实践开发定制化AI工具。

AIbase注意到,社区测试显示,Cursor的提示词通过明确的安全性与工具使用规范,显著减少了代码生成中的“幻觉”问题,而Manus的复杂指令则展示了代理型AI的多任务处理能力。

技术架构:系统提示词的结构与功能

该项目不仅提供了原始提示词,还揭示了AI工具背后的设计逻辑。AIbase分析,其技术亮点包括:

角色定义与约束:如Windsurf的Cascade代理定义为“自主行动的编程助手”,基于AI Flow范式,强调独立任务执行;Cursor则通过Claude3.7模型,注重代码修改的可用性与安全性。

提示工程实践:提示词中频繁提及“best practices”,如Cursor通过结构化指令减少AI偏离,Manus则通过多步骤推理优化复杂任务处理。

模块化设计:各工具的提示词分为角色描述、行为规则、工具调用与输出格式,方便开发者复用或定制,例如v0的UI生成提示词可直接用于React组件开发。

安全警示:项目强调AI初创公司需保护提示词与模型配置,推荐ZeroLeaks服务以防止数据泄露,凸显行业安全意识。

AIbase认为,该项目的价值在于其系统性与透明度,为提示工程提供了实操案例,类似一本“AI工具设计教科书”。

应用场景:从学习到企业开发

“system-prompts-and-models-of-ai-tools”项目的丰富内容使其适用于多种场景。AIbase总结了其主要应用:

提示工程学习:开发者可通过分析Cursor、Devin等工具的提示词,掌握如何设计高效指令,优化LLM输出,适合AI工程师与研究者。

AI工具开发:初创公司可借鉴Lovable的协作指令或v0的UI生成逻辑,开发定制化AI产品,加速原型验证。

教育与培训:高校与培训机构可将提示词库作为教学资源,帮助学生理解AI系统的行为逻辑与设计原则。

安全与合规:企业可参考项目建议,使用ZeroLeaks等工具检测提示词泄露风险,确保AI系统的安全性。

社区反馈显示,开发者通过研究Devin的提示词,优化了自家AI代理的多任务处理能力,生成代码的错误率降低约10%。AIbase观察到,项目的30.5K星反映了开发者对透明AI设计的高度需求。

上手指南:快速访问与研究

AIbase了解到,该项目现已通过GitHub(github.com/x1xhlol/system-prompts-and-models-of-ai-tools)免费开放,包含详细的提示词文件与使用说明。开发者可按以下步骤快速上手:

访问GitHub仓库,克隆或Fork项目(github.com/x1xhlol/system-prompts-and-models-of-ai-tools);

浏览9大工具的提示词目录(如Cursor Prompts、Devin AI),查看具体文件(如cursor_agent.txt、devin.txt);

使用Python或其他脚本解析提示词,提取角色定义、工具调用或约束逻辑;

参考ZeroLeaks(zeroleaks.vercel.app)进行安全审计,保护自有AI系统。

社区建议优先研究Cursor与v0的提示词,因其结构清晰且应用场景广泛。AIbase提醒,项目已停止使用GitHub Issues,建议通过System Prompts Roadmap & Feedback页面提交建议。

社区反响与改进方向

“system-prompts-and-models-of-ai-tools”发布后,社区对其全面性和学习价值给予高度评价。开发者称其“为AI工具设计提供了无价的参考”,尤其Cursor与Manus的提示词被认为是提示工程的典范。 然而,部分用户指出,项目缺少视频生成工具的提示词,建议增加Runway或Pika的案例。社区还期待更详细的解析文档,说明各提示词的上下文与应用场景。开发团队回应称,未来将扩展工具覆盖范围并优化文档。AIbase预测,项目可能与MCP协议或ComfyUI集成,构建提示词测试与优化的工作流。

未来展望:AI设计透明化的催化剂

“system-prompts-and-models-of-ai-tools”以30.5K星的热度彰显了开发者对AI透明设计的渴求。AIbase认为,其开源模式不仅推动了提示工程的普及,还为AI初创公司提供了安全与设计的双重启示。社区已在探讨将其与即梦3.0或Lovable2.0的工作流结合,构建从提示设计到应用开发的生态。长期看,项目可能演变为“AI提示词市场”,提供共享与定制化服务,类似Hugging Face的模型生态。AIbase期待2025年项目的进一步扩展,尤其是在多模态AI与安全防护上的突破。

项目地址:https://github.com/x1xhlol/system-prompts-and-models-of-ai-tools

评论 (0)